剖析大数据平台的数据处理与数据分析

在当今信息爆炸的时代,大数据平台已成为企业决策和业务优化的核心工具。数据处理和数据分析作为大数据平台的两大关键环节,共同构成了从原始数据到商业价值的转化链条。本文将深入剖析大数据平台中数据处理与数据分析的流程、方法及其相互关系。

一、数据处理:构建数据基础

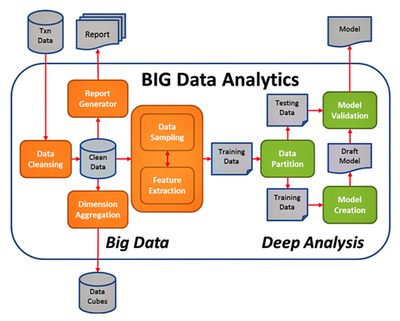

数据处理是大数据平台的首要步骤,旨在将原始数据转化为可用于分析的结构化信息。这一过程通常包括数据采集、清洗、转换和存储四个主要阶段。

数据采集环节涉及从各类数据源(如数据库、日志文件、传感器、社交媒体等)收集数据。现代大数据平台采用批量采集和实时流式采集相结合的方式,确保数据的全面性和时效性。

数据清洗是确保数据质量的关键步骤,包括去除重复记录、填补缺失值、纠正错误数据等操作。高质量的数据是后续分析准确性的基础保障。

数据转换环节将清洗后的数据转化为统一的格式和结构,可能包括数据归一化、特征工程、数据聚合等操作。这一步骤为数据分析提供了标准化的输入。

数据存储则采用分布式存储系统(如HDFS、NoSQL数据库等)来管理海量数据,确保数据的可靠性、可扩展性和高效访问。

二、数据分析:挖掘数据价值

数据分析是建立在数据处理基础上的高级阶段,旨在从数据中提取洞察和价值。根据分析深度和目的的不同,可分为描述性分析、诊断性分析、预测性分析和规范性分析四个层次。

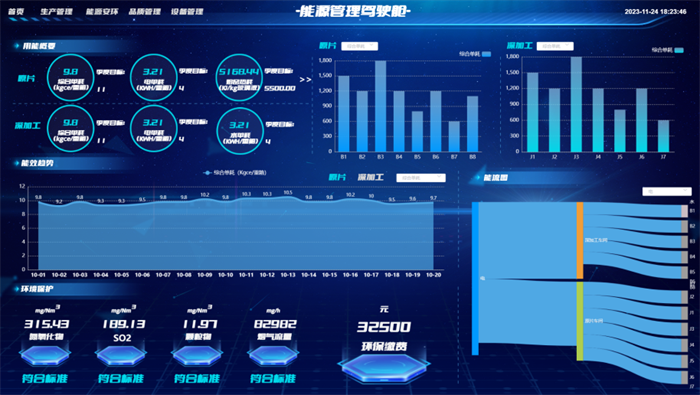

描述性分析回答"发生了什么"的问题,通过对历史数据的统计和可视化,揭示业务现状和趋势。常见的工具有报表系统、仪表盘等。

诊断性分析探究"为什么会发生",通过关联分析、回归分析等方法,找出影响业务结果的关键因素和因果关系。

预测性分析着眼于"将会发生什么",运用机器学习、时间序列分析等技术,基于历史数据预测未来趋势和潜在风险。

规范性分析则提供"应该怎么做"的建议,通过优化算法和仿真模型,为决策者提供最优的行动方案。

三、数据处理与数据分析的协同

在大数据平台中,数据处理与数据分析并非孤立的环节,而是紧密相连的闭环系统。高质量的数据处理为准确的数据分析奠定基础,而数据分析的结果又反过来指导数据处理流程的优化。

现代大数据平台通过构建数据流水线(Data Pipeline)实现两者的无缝衔接。例如,实时流处理系统可以同时完成数据清洗和实时分析;数据湖架构支持原始数据的存储和按需分析;机器学习平台则整合了特征工程和模型训练的全流程。

四、技术架构与发展趋势

典型的大数据平台采用分层架构,包括数据采集层、存储层、计算层和分析层。Hadoop、Spark、Flink等开源框架为数据处理和分析提供了强大的技术支撑。

当前,大数据平台正朝着智能化、实时化和云原生的方向发展。AI增强的数据处理、实时流分析、Serverless架构等新兴技术正在重塑数据处理与分析的方式,使得企业能够更快地从数据中获取价值。

结语

大数据平台的数据处理与数据分析是一个有机整体,前者是基础,后者是目标。只有构建高效可靠的数据处理流程,才能支撑深入准确的数据分析;而通过数据分析获得的洞见,又能指导数据处理流程的持续优化。在数字化转型的浪潮中,深入理解并优化这两个环节的协作,将成为企业数据驱动决策能力的关键所在。

如若转载,请注明出处:http://www.iata-boms.com/product/8.html

更新时间:2026-01-13 14:48:10